연구

최신연구

View

| [한욱신 교수] SPARTA: Scalable and Principled Benchmark of Tree-Structured Multi-hop QA over Text and Tables | ||

|---|---|---|

| 작성자 시스템 | 작성일 26/03/23 (00:00) | 조회수 547 |

[연구의 필요성]

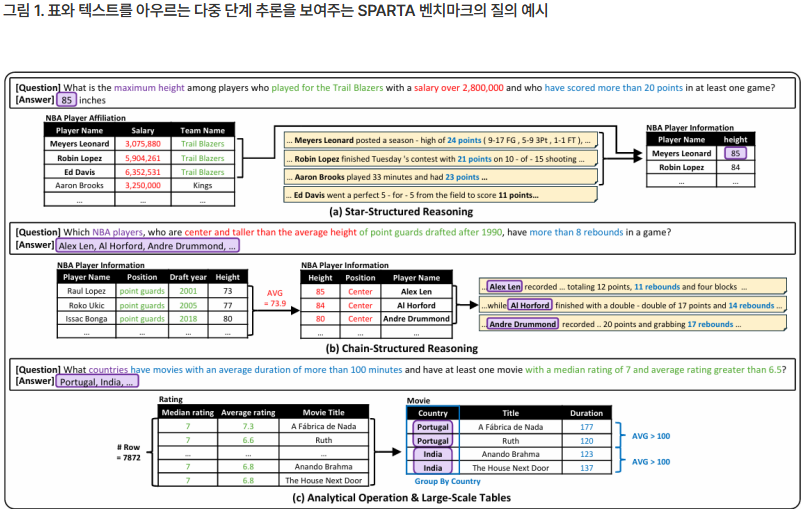

표(Table)와 텍스트(Text)가 혼합된 데이터에서 복잡한 질문에 답하는 기술은 현대 AI의 핵심 역량 중 하나이다. 하지만 기존의 벤치마크 데이터셋(HybridQA, OTT-QA 등)은 세 가지 치명적인 한계를 지니고 있다. 첫째, 사람이 수작업으로 문제를 만들다 보니 오류율이 최대 21~30%에 달할 정도로 데이터 품질이 낮다. 둘째, 추론 과정이 단순한 선형 구조에 그치며, 데이터 규모 또한 평균 15행 내외의 소규모 '장난감(Toy)' 수준에 머물러 있다. 셋째, 실제 비즈니스 환경에서 필수적인 집계(Aggregation)나 그룹화(Grouping)와 같은 고차원적인 분석 연산이 거의 포함되지 않았다. 따라서 LLM의 진정한 복잡 추론 능력을 평가하기 위해서는 대규모의 정교하고 신뢰할 수 있는 새로운 벤치마크 생성 프레임워크가 절실히 필요한 실정이다.

[포스텍이 가진 고유의 기술]

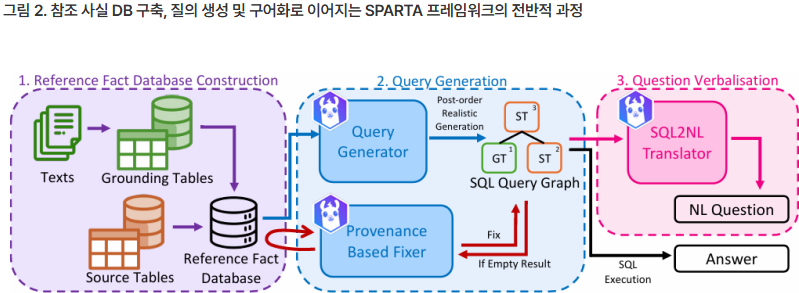

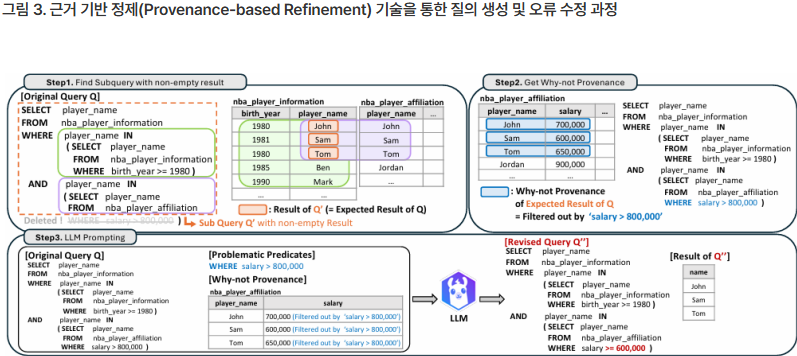

본 연구진은 이러한 한계를 극복하기 위해, 대규모의 트리 구조 다중 단계(Tree-structured Multi-hop) 질의응답 데이터를 자동으로 생성하는 혁신적인 프레임워크 SPARTA를 제안하였다. SPARTA는 먼저 비정형 텍스트를 원자적 사실로 분해하여 표 형태의 '그라운딩 테이블'로 변환하고, 이를 기존 소스 표와 통합하여 모든 정보를 SQL로 조회 가능한 '참조 사실 데이터베이스(Reference Fact Database)'를 구축한다. 이후 LLM이 복잡한 SQL 쿼리를 생성할 때, 실행 결과가 없는 오류를 방지하기 위해 '근거 기반 정제(Provenance-Based Refinement)' 기술을 적용한다. 이는 결과가 나오지 않는 원인(Why-not provenance)을 분석해 질의 조건을 자동으로 수정함으로써 쿼리의 실행 가능성을 보장한다. 또한, 실제 분석가의 사고방식을 모방하는 '실제 구조 강제(Realistic-Structure Enforcement)' 기법을 통해 사람이 질문한 것과 같은 자연스러운 질의응답 쌍을 생성해낸다.

[연구의 의미]

본 연구는 기존 수작업 방식 대비 주석 작업 시간을 4분의 1로 단축하면서도, 100개 질의 샘플링 검사 결과 오류율 0%라는 압도적인 데이터 신뢰도를 달성했다. SPARTA는 수천 행 이상의 대규모 데이터를 다루며, 단순한 나열을 넘어 집계 및 그룹화가 포함된 복잡한 트리 구조 추론을 요구한다. 실험 결과, 기존 벤치마크에서 우수한 성능을 보였던 최첨단(SOTA) 모델들이 SPARTA에서는 F1 점수가 30점 이상 급락하는 모습을 보였다. 이는 현재의 AI 모델들이 복잡한 교차 모달(Cross-modal) 추론에서 여전히 큰 한계를 가지고 있음을 정밀하게 타격하여 보여준 것으로, 향후 더욱 강력하고 견고한 QA 시스템 개발을 위한 새로운 이정표를 제시했다는 점에서 그 의의가 매우 크다.

[연구결과의 진행 상태 및 향후 계획]

본 연구는 인공지능 분야 세계 최고 권위의 학술 대회인 ICLR 2026에 게재되어 발표될 예정이다. SPARTA는 현재 NBA, 영화, 의료 등 다양한 도메인을 지원하고 있으며, 연구진은 향후 이 프레임워크를 더욱 확장하여 금융, 법률 등 전문 지식이 필요한 복잡한 산업 분야나 이미지, 비디오와 같은 새로운 모달리티를 지원하도록 방법론의 적용 범위를 넓힐 계획이다. 또한, 본 연구를 통해 드러난 LLM의 추론 취약점을 보완할 수 있는 새로운 모델 구조 및 학습 방법론에 대한 후속 연구를 활발히 진행하고있다.

[성과와 관련된 실적]

Park, S., Kim, J., and Han, W., “SPARTA: Scalable and Principled Benchmark of Tree-Structured Multi-hop QA over Text and Tables,” In Proc., the 14th International Conference on Learning Representations, ICLR, Rio de Janeiro, Brazil, April 2026.

(관련 홈페이지) https://sparta.postech.ac.kr/

[성과와 관련된 이미지]