연구

최신연구

View

| [곽수하/조민수 교수] Online Temporal Action Localization with Memory-augmented Transformer | ||

|---|---|---|

| 작성자 시스템 | 작성일 24/10/07 (00:00) | 조회수 53 |

[연구의 필요성]

이 연구는 실시간 스트림 비디오의 수요가 높아짐에 따라 보다 범용적으로 활용할 수 있는 온라인 시간적 행동 지역화 (Online Temporal Action Localization) 문제를 해결하고자 한다. 기존 연구들은 각 프레임 결과를 활용하여 행동 구간 (Action Interval)에 잦은 노이즈가 생기거나, 짧은 과거 정보 (Short-term Memory)만 사용하여 정확하지 않은 행동 구간을 예측하는 문제가 있다. 본 연구에서는 더 긴 구간의 과거 정보 (Long-term Memory)를 효율적으로 저장하여 행동 구간을 직접적으로 예측함으로써 이러한 문제들을 해결하고자 한다.

[포스텍이 가진 고유의 기술]

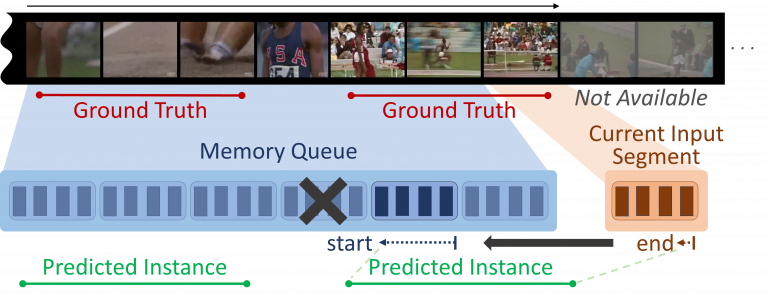

본 연구에서는 플레그 (Flag)를 활용하여 유용한 과거 정보를 선별적으로 메모리 큐 (Memory Queue)에 저장한다. 플레그는 해당 정보 묶음 (Segment)와 정답 행동 지역 (Ground-truth Action Instance)사이의 겹치는 프레임이 있는지를 판단하여 학습한다. 또한, 행동 구간의 시작과 끝을 한번에 예측하는 것이 아닌, 끝 지점을 짧은 과거 정보만을 활용하여 먼저 예측한 뒤 예측된 끝 지점과 관련된 시작 지점을 긴 과거 정보를 이용하여 예측하는 방식을 활용한다.

[연구의 의미]

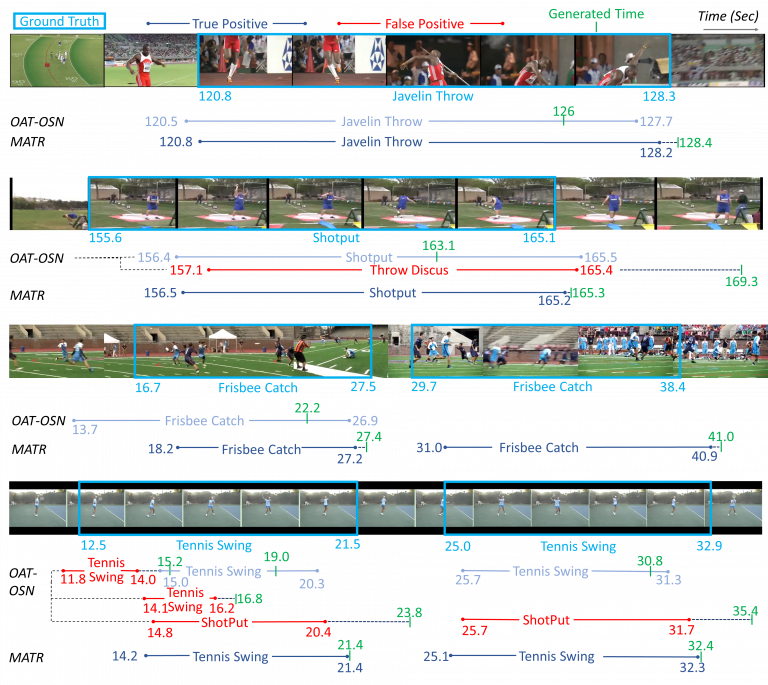

본 연구에서 제안한 선별적으로 저장하는 메모리 큐와 순차적인 행동 구간 예측은 기존 연구보다 더 정확한 행동 지역 예측을 가능하게 한다. 특히, 메모리를 사용하는 방식으로 인해 매 연산마다 사용해야 하는 짧은 과거 정보의 양을 크게 줄일 수 있고, 이는 실제 모델을 사용할 때의 연산 속도를 높이는 결과로 이어진다. 또한, 순차적인 행동 구간 예측은 시작과 끝을 동시에 예측하는 방식에 비해 큰 성능 향상을 가져왔는데, 이를 통해 시작과 끝을 예측하기 위해 필요한 정보에 차이가 있고, 시작을 예측할 때 예측된 끝 지점에 대한 정보를 활용하는 것이 효과적임을 보여준다.

[연구결과의 진행 상태 및 향후 계획]

본 연구는 European Conference on Computer Vision 2024 학회에서 구두 발표될 예정이다. 향후 보다 복잡한 비디오 연구에 해당 메모리 구조를 활용할 계획이다.

[성과와 관련된 실적]

Youngkil Song*, Dongkeun Kim*, Minsu Cho, Suha Kwak, “Online Temporal Action Localization with Memory-augmented Transformer.” ECCV 2024

[성과와 관련된 이미지]